Happy Birthday, Geoffrey Hinton!

Geschrieben am 06.12.2022 von HNF

Er zählt zu den Stars der aktuellen Künstlichen Intelligenz, die auf neuronalen Netzen basiert: Geoffrey Hinton. Im Oktober 1986 veröffentlichte der englische Forscher mit zwei Kollegen einen Aufsatz über die Backpropagation. Sie wurde zur wichtigsten Technik des maschinellen Lernens. 2019 erhielt er den Turing-Preis, den Nobelpreis der Informatik. Heute feiert Geoffrey Hinton den 75. Geburtstag.

Geoffrey Hinton wurde am 6. Dezember 1947 im Londoner Stadtteil Wimbledon geboren. Der Vater war Insektenkundler, der eine Stelle an der Universität von Bristol erhielt. Ob der junge Geoffrey vom dort tätigen William Grey Walter und seinen kybernetischen Automaten erfuhr, wissen wir leider nicht. Zu den Vorfahren Hintons gehören der Logiker George Boole, der Mathematiker Charles Hinton – er grübelte über die vierte Dimension – und der Geodät George Everest, nach dem der Mount Everest im Himalaya benannt ist.

Nach dem Ende der Schulzeit studierte Geoffrey Hinton Psychologie in Cambridge und Informatik an der Universität Edinburgh. 1977 lag seine Dissertation vor; sie behandelt das maschinelle Sehen. Ab 1978 arbeitete er an der Universität von Kalifornien in San Diego und der Carnegie-Mellon Universität Pittsburgh; zwischen Oktober 1980 und September 1982 war er noch einmal in Cambridge tätig. Im Juli 1987 zog er nach Kanada und wurde Informatik-Professor in Toronto. Von Juli 1998 bis September 2001 leitete er eine neu gegründete Abteilung im Londoner University College.

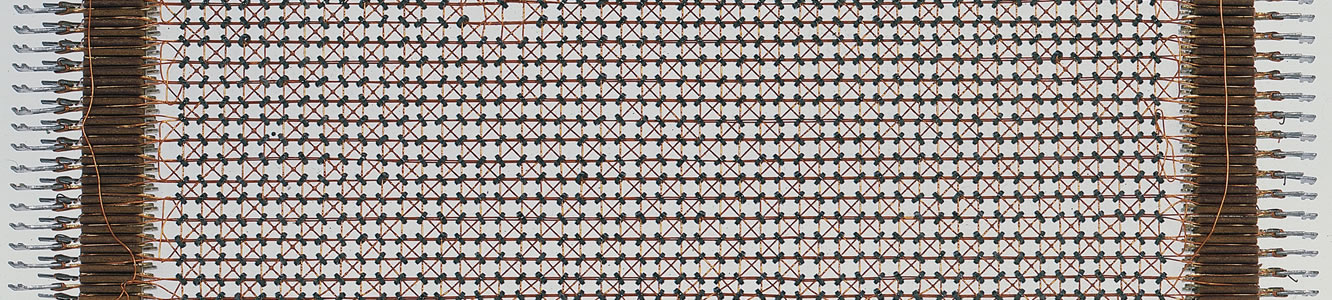

Geoffrey Hintons Fachgebiet ist die Künstliche Intelligenz oder KI, der Zweig der Informatik, der sich mit schlauen Computerprogrammen befasst. Die 1960er- bis 1990er-Jahre waren die Ära der symbolischen KI. Dabei ging ein Programm nach festen Regeln vor, man denke an Expertensysteme oder Schachcomputer. Hinton interessierte sich aber für eine andere Art von Software, die neuronalen Netze. Sie modellierten aufeinander folgende Gruppen von Rechenzellen, die ein lernendes System ergaben. Die Grundidee stammte vom deutschen Kybernetiker Karl Steinbuch und dem Amerikaner Frank Rosenblatt.

Das Hauptproblem eines solchen Systems ist die Optimierung: Wie kann man möglichst schnell die Einheiten des Netzes einstellen, damit sich die gewünschte Lernleistung ergibt? Dazu beschrieb Geoffrey Hinton 1986 mit seinen Fachkollegen David Rumelhart und Ronald Williams ein Verfahren namens Backpropagation; wir lassen das Wort einmal unübersetzt. Hierbei führt das neuronale Netz eine mathematische Selbstanalyse aus und ändert seine Parameter. Der Aufsatz der drei Forscher erschien in der Zeitschrift Nature; wir empfehlen auch den Begleittext. Eine populäre Fassung stand 1992 in der Scientific American.

Hinton, Rumelhart und Williams haben die Backpropagation nicht erfunden, ihr Konzept verbreitete sich aber in der Künstlichen Intelligenz durch einen Sammelband mit thematisch ähnlichen Arbeiten. Die einst wenig geschätzten neuronalen Netze gewannen neue Freunde; im 21. Jahrhundert führte dann der Fortschritt der Hardware zum Triumph des maschinellen Lernens über die symbolische KI. Daran hatte Geoffrey Hinton als Leiter von Arbeitsgruppen und Autor oder Co-Autor von Fachartikeln einen beträchtlichen Anteil.

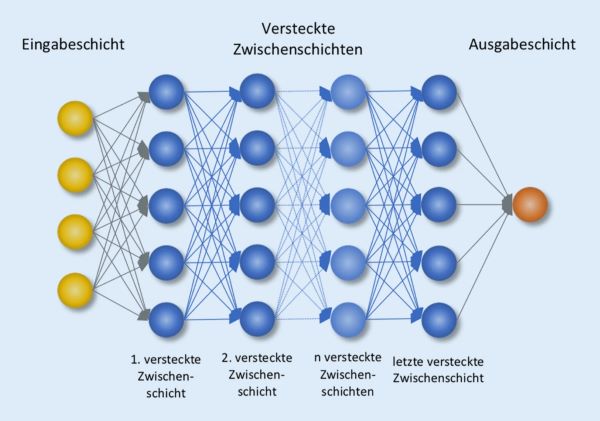

Ein mehrschichtiges neuronales Netz (Foto Bennani-Baiti, B., Baltzer, P.A.T. CC BY 4.0)

Sein Aufsatz A Fast Learning Algorithm for Deep Belief Nets von 2006 – es wirkten noch zwei Co-Autoren mit – gilt als Startschuss für die Technik des Deep Learning. Das von ihm initiierte AlexNet machte 2012 Furore im Feld der Bilderkennung; der Name geht auf Hintons Studenten Alex Krizhevsky zurück. Neben der schon erwähnten Backpropagation widmete sich Geoffrey Hinton anderen grundlegenden Konzepten, der Boltzmann-Maschine und der Helmholtz-Maschine. Ein Verzeichnis seiner Veröffentlichungen findet sich hier.

Der SPIEGEL entdeckte den Forscher 2016 vor dem Go-Turnier, in dem das KI-Programm AlphaGo den Weltmeister Lee Sedol besiegte. 2019 erhielt Geoffrey Hinton zusammen mit dem Kanadier Yoshua Bengio und dem Franzosen Yann LeCun den Turing-Preis, die höchste Auszeichnung in der Informatik. Belohnt wurden Verdienste im Gebiet des tiefen Lernens. Eine gute Darstellung desselben liefert ein Artikel des Trios, der schon 2015 erschien; das ist ein neuerer Beitrag der drei Wissenschaftler dazu.

Hörenswert sind auch die Turing-Preis-Vorträge von Hinton und LeCun aus dem Juni 2019. In der Diskussion gegen Ende läuft eine Frage zur Undurchschaubarkeit der neuronalen Netze ein. Hinton kann darauf nur antworten, dass Menschen Intuitionen haben und neuronale Netze ebenfalls. Heute arbeitet er teils in Toronto und teils für Google im kalifornischen Mountain View. Zum 75. Geburtstag wünschen wir Geoffrey Hinton alles Gute, Gesundheit und noch weitere erfolgreiche Forscherjahre.